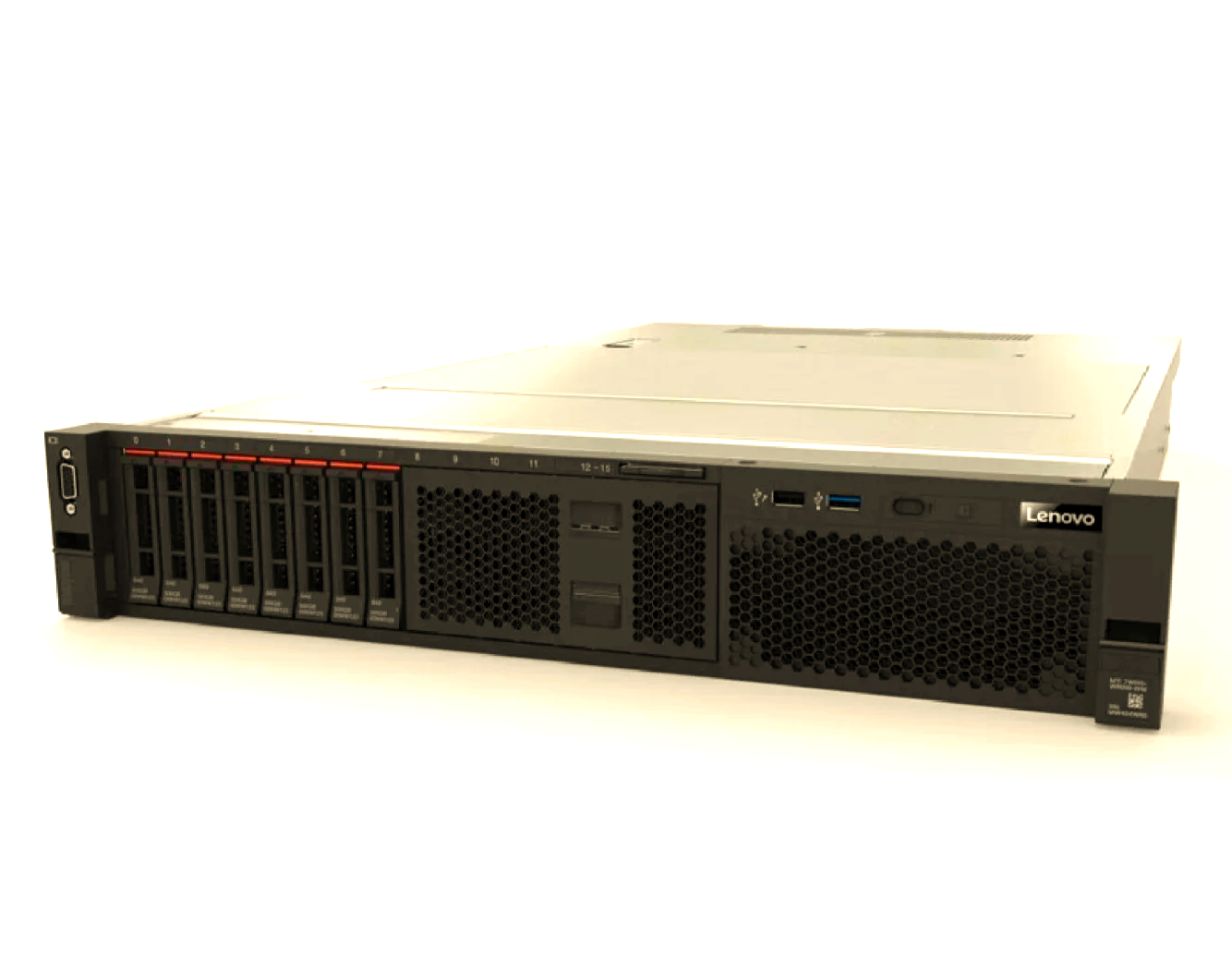

至强多卡GPU服务器 驱动深度学习与AI未来的4U工作站

在人工智能与深度学习迅猛发展的今天,强大的计算力是推动前沿研究与产业落地的核心引擎。至强多卡GPU服务器,尤其是经典的4U机架式工作站,凭借其卓越的性能、出色的扩展性与稳定的可靠性,已成为高校实验室、科研机构及企业研发部门的标配,是构建AI算力基础设施的坚实基石。

一、 硬件基石:性能与扩展的完美平衡

一台顶级的4U深度学习工作站,其强大始于硬件架构的精妙设计。

- 强劲的“大脑”——英特尔至强可扩展处理器:搭载一颗或多颗高性能英特尔至强(Xeon)可扩展处理器(如最新的至强铂金系列),提供海量的核心与线程数,以及巨大的内存带宽。这不仅为大规模数据预处理、复杂模型逻辑运算提供了保障,更能高效管理多块高性能GPU,消除系统瓶颈,确保算力充分释放。

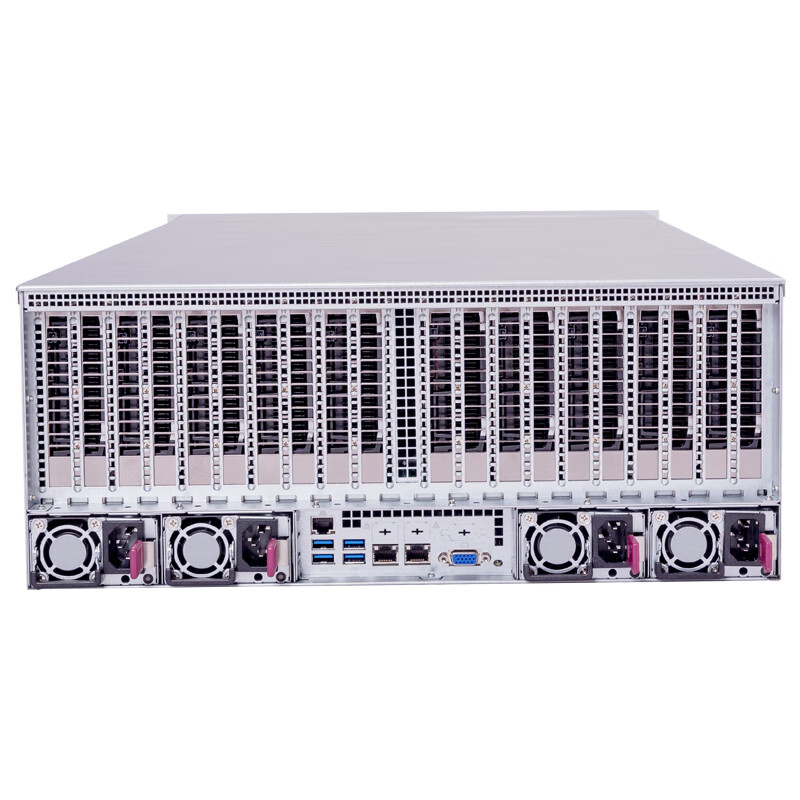

- 澎湃的“算力核心”——多卡高性能GPU:4U的充裕空间允许部署多块(通常4-8块,甚至更多)顶级计算卡,如NVIDIA A100、H100或消费级的RTX 4090等。这些GPU搭载数以万计的CUDA核心和专用Tensor Core,专为并行浮点运算与矩阵计算优化,是训练百亿、千亿参数大模型和进行高精度推理的绝对主力。支持NVLink高速互联技术,能实现GPU间超低延迟、高带宽的数据交换,极大提升多卡协同效率。

- 海量的“记忆库”——高速大容量内存与存储:配备高达数TB的ECC注册式内存,确保在加载超大规模数据集和模型时稳定流畅。存储方面,通常采用NVMe SSD组成RAID阵列作为高速缓存和系统盘,搭配大容量SATA/SAS HDD或更多SSD作为数据仓库,实现从数据载入到模型保存的全流程高速化。

- 高效的“循环系统”——散热与电源:强大的硬件必然产生巨大热量。4U服务器工作站采用优化的风道设计和高性能冗余散热系统,确保在满负荷运行时核心部件温度可控。80 Plus铂金或钛金级冗余电源则为整个系统提供持续、纯净、稳定的电力供应,保障7x24小时不间断运行的可靠性。

二、 核心应用场景:从研究到落地的全栈赋能

这类工作站并非简单的硬件堆砌,而是针对特定高强度计算场景的深度优化。

- 大规模深度学习模型训练:无论是计算机视觉(CV)中的目标检测与图像生成,自然语言处理(NLP)中的大语言模型预训练与微调,还是科学计算中的分子动力学模拟,都需要迭代海量数据、调整数以亿计的参数。多卡GPU服务器提供的并行计算能力,能将训练时间从天级缩短到小时级,加速研发周期。

- 复杂AI推理与部署测试:在将训练好的模型部署到生产环境(如边缘设备、云服务器)之前,需要在与生产环境近似的硬件上进行严格的性能测试、优化和压力测试。4U工作站可以模拟多路并发推理场景,验证模型的吞吐量、延迟和准确性,是产品化前的关键一环。

- 高性能计算(HPC)与仿真:在金融工程、气候预测、流体力学、基因测序等传统HPC领域,GPU加速计算也已普及。多卡服务器能够高效处理这些领域的并行计算任务,提供远超传统CPU集群的能效比。

- 研究与教学平台:为高校和研究所提供稳定、共享的高性能计算平台,支持多名研究者同时进行不同项目的实验,降低单人使用门槛,促进学术创新。

三、 选择与部署考量

在构建或选购这样一台AI主机时,需综合考量:

- 任务导向:明确主要负载是训练还是推理,模型规模和数据量大小,以决定GPU型号、数量及内存容量。

- 扩展与互联:关注主板PCIe通道数、带宽(如PCIe 4.0/5.0)以及是否支持GPU间高速互联(NVLink),这直接影响多卡效率。

- 软件与生态兼容性:确保硬件与主流的深度学习框架(如TensorFlow, PyTorch)、CUDA工具链以及容器化部署方案(如Docker, Kubernetes)完全兼容。

- 运维与成本:评估电力消耗、散热需求、机房环境以及总体拥有成本(TCO)。4U服务器虽然性能强大,但也需要专业的运维管理。

###

至强多卡GPU服务器工作站,以其模块化、高密度的4U形态,集成了当前最先进的通用计算与加速计算技术。它不仅是实验室中攻克AI难题的“超级大脑”,也是产业界实现AI赋能的核心装备。随着算法模型的不断进化,对算力的渴求永无止境,这类高性能工作站将继续作为基础设施的关键组成部分,持续推动人工智能技术向更深、更广的领域迈进,塑造智能化未来。

如若转载,请注明出处:http://www.vorolife.com/product/16.html

更新时间:2026-05-31 03:10:33